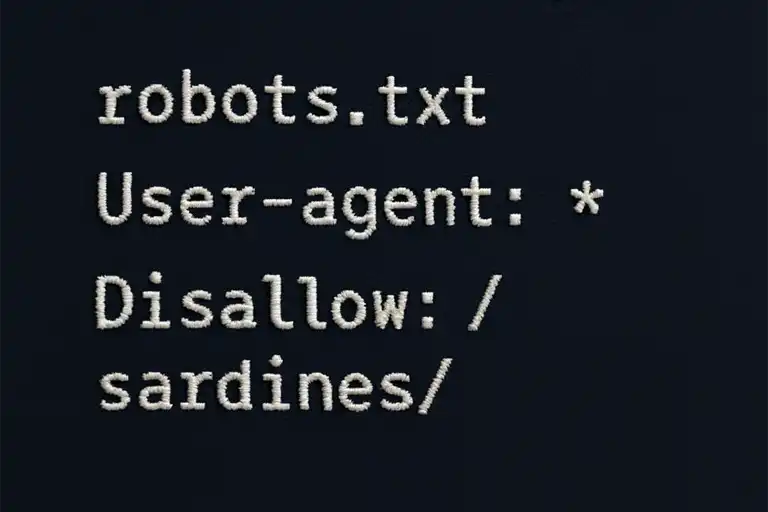

robots.txt — это текстовый файл, который лежит в корне вашего сайта (например, https://example.com/robots.txt) и управляет поведением поисковых роботов. Он сообщает роботам, какие страницы можно сканировать и индексировать, а какие — нет.

Основная цель robots.txt:

- Предотвратить индексацию конфиденциальных страниц (например, админ-панели или тестовых страниц).

- Экономить бюджет сканирования (crawl budget) для больших сайтов.

- Улучшать SEO, ограничивая попадание в индекс бесполезных или дублирующихся страниц.

Файл robots.txt не гарантирует, что поисковики полностью исключат страницу из поиска — это лишь рекомендация для «добросовестных» роботов (например, Googlebot).

Основной синтаксис robots.txt

Файл состоит из нескольких ключевых директив:

- User-agent

Определяет, к какому роботу применяются правила. Пример:User-agent: *Здесь*означает «все роботы». Можно указывать конкретные роботы, например:User-agent: Googlebot User-agent: Bingbot - Disallow

Запрещает роботам доступ к указанным страницам или папкам. Примеры:Disallow: /admin/ Disallow: /private-page.html Disallow: /wp-admin/ - Allow

Разрешает доступ к страницам или папкам, даже если родительская директория запрещена. Особенно важно для WordPress и других CMS, где есть папки с ограниченным доступом. Пример:Disallow: /wp-admin/ Allow: /wp-admin/admin-ajax.php - Sitemap

Указывает расположение карты сайта, чтобы роботы быстрее находили все страницы:Sitemap: https://example.com/sitemap.xml

Правила написания

- Файл должен быть в корне сайта.

Например:https://example.com/robots.txt - Один файл на сайт.

Нельзя иметь несколько robots.txt для одной доменной зоны. - Кодировка — UTF-8.

Желательно использовать без BOM, чтобы поисковые системы корректно распознавали файл. - Комментарии начинаются с #

Пример:# Запрещаем доступ к админке Disallow: /admin/ - Порядок важен.

Если есть несколько правил для одного User-agent, они читаются сверху вниз, а Allow/Disallow применяются в совокупности.

Пример robots.txt для WordPress

WordPress генерирует динамические страницы и имеет много служебных URL. Правильный файл может выглядеть так:

User-agent: *

Disallow: /wp-admin/

Allow: /wp-admin/admin-ajax.php

Disallow: /wp-login.php

Disallow: /wp-register.php

Disallow: /tag/

Disallow: /category/

Disallow: /author/

Disallow: /?s=

Disallow: /*?*

Sitemap: https://example.com/sitemap.xml

Объяснение:

/wp-admin/— запрещает доступ к административной панели./wp-admin/admin-ajax.php— разрешает AJAX-запросы, которые нужны для работы сайта./tag/,/category/,/author/— блокируем дублирующий контент./?s=— поисковые запросы WordPress лучше не индексировать./*?*— запрещает индексацию любых URL с параметрами.

Пример robots.txt для любой CMS

Для любой CMS (Joomla, Drupal, Shopify, OpenCart и т.д.) важно:

- Определить административные папки и страницы.

- Определить динамические и дублирующиеся страницы.

- Оставить публичные страницы открытыми.

- Указать Sitemap для быстрой индексации.

Общий пример:

User-agent: *

Disallow: /admin/

Disallow: /login/

Disallow: /cart/

Disallow: /checkout/

Allow: /images/

Allow: /css/

Allow: /js/

Sitemap: https://example.com/sitemap.xml

Проверка robots.txt

После создания важно проверить файл:

- Он доступен по URL:

https://example.com/robots.txt - Валидация для Google: Использовать Google Search Console → Проверка robots.txt

- Проверка синтаксиса: Простые онлайн-инструменты (например, technicalseo.com)

Частые ошибки

- Разрешить всё (

Disallow:пусто) и ждать защиты от индексации → не работает для закрытых страниц. - Запретить доступ ко всем страницам (

Disallow: /) → сайт перестанет индексироваться. - Использовать неправильный путь (например

/Admin/вместо/admin/) → чувствительно к регистру. - Использовать robots.txt как средство безопасности → не защищает страницы, это лишь рекомендация для роботов.

Итоговые рекомендации

- Всегда начинайте с

User-agent: *. - Закрывайте админ-панель, страницы с личными данными, поисковые и дублирующиеся страницы.

- Разрешайте доступ к статическим ресурсам (

/images/,/js/,/css/). - Указывайте Sitemap.

- Проверяйте файл после внесения изменений.